Die Nutzung von KI-Sprachmodellen (LLMs) lokal auf dem eigenen Computer bietet zahlreiche Vorteile. In diesem Beitrag zeige ich dir eine einfache und kostenlose Lösung, wie du LLMs wie Llama 3 auf deinem PC installieren und nutzen kannst.

Warum LLMs lokal nutzen?

Die lokale Nutzung von LLMs bringt viele Vorteile:

- Datenschutz: Deine Daten bleiben auf deinem eigenen Gerät und werden nicht über das Internet übertragen.

- Geschwindigkeit: Unabhängig von der Internetgeschwindigkeit sind schneller Ergebnisse möglich.

- Verfügbarkeit: Selbst in Gebieten ohne Internetzugang kannst du die Modelle nutzen.

Wie kann man KI-Sprachmodelle lokal nutzen?

Es gibt verschiedene Möglichkeiten, KI-Sprachmodelle lokal zu nutzen:

- Nutzung von Open-Source-Frameworks: Tools wie TensorFlow oder PyTorch ermöglichen es, LLMs lokal auszuführen, erfordern jedoch ebenfalls technisches Know-how.

- Desktop-Anwendungen: Tools wie LM Studio bieten eine benutzerfreundliche Lösung für die lokale Nutzung von LLMs ohne tiefgehende technische Kenntnisse.

Sehr einfach ist es mit LM Studio – daher zeige ich dir diesen Ansatz im Detail:

Was ist LM Studio?

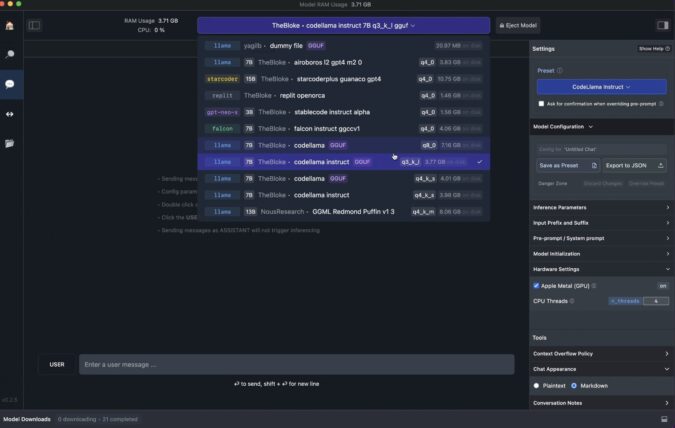

LM Studio ist eine Anwendung, die es ermöglicht, leistungsstarke Sprachmodelle direkt auf deinem Computer zu betreiben. Es erleichtert den Download, die Installation und die Nutzung verschiedener LLMs und bietet eine benutzerfreundliche Oberfläche.

Installation von LM Studio

Die Installation von LM Studio erfolgt in wenigen Schritten:

- Download: Lade die Anwendung von der LM Studio Webseite herunter.

- Installation: Folge den Anweisungen für dein Betriebssystem (Windows, macOS, Linux).

- Starten: Öffne die Anwendung und richte deinen Account ein.

Mindestanforderungen

Um LM Studio effizient nutzen zu können, sollten die folgenden Mindestanforderungen erfüllt werden:

- Prozessor: Mindestens ein Quad-Core-Prozessor

- Arbeitsspeicher: Mindestens 16 GB RAM

- Festplattenspeicher: Ausreichend Speicherplatz für die Daten der verschiedenen Sprachmodelle (mindestens 100 GB)

- Grafikkarte: Eine moderne GPU (z.B. Nvidia RTX 20-Serie oder besser) für optimale Leistung

Modelle herunterladen und nutzen

Mit LM Studio hast du Zugriff auf verschiedene LLMs unter anderem auch auf Llama 3. Die Nutzung ist einfach und intuitiv gestaltet und du kannst die KI-Sprachmodelle direkt innerhalb von LLM Studio mit einem Klick installieren:

- Modell suchen: In LM Studio nach dem gewünschten Modell suchen.

- Download: Das Modell herunterladen und in der Anwendung installieren.

- Nutzung: Sofort in der integrierten Chat-Oberfläche anwenden..

Integration in Anwendungen (lokale API)

LM Studio bietet auch die Möglichkeit, Modelle über eine lokale API in eigene Anwendungen zu integrieren. Diese Möglichkeit ist ideal für Entwickler. Ich persönlich habe diese Funktion aber noch nicht genutzt (und benötige sie auch nicht).

👉Lese-Tipp: Die besten KI-Tools